Guide Labs 震撼发布:可解释LLM新时代开启

在AI技术迅猛发展的2026年,Guide Labs宣布推出Steerling-8B,一款开创性的8亿参数大语言模型(LLM)。这款模型不仅开源,还采用全新架构设计,旨在解决传统LLM的'黑箱'难题,让模型的决策过程变得透明易懂。根据TechCrunch报道,该公司于2月24日正式亮相这一创新成果,作者Tim Fernholz详细剖析了其技术亮点。

公司开源了一款8亿参数LLM,Steerling-8B,使用新架构训练而成,旨在使其行为易于解释。

Guide Labs作为一家专注于AI可解释性的初创企业,此次发布迅速引发行业热议。传统LLM如OpenAI的GPT-4o或Anthropic的Claude系列,虽然在自然语言处理、代码生成等领域表现出色,但其内部机制往往如'魔法黑箱',开发者难以追踪错误来源或注入自定义逻辑。这导致在高风险场景如医疗、金融中的应用受限。

Steerling-8B的核心创新:透明架构揭秘

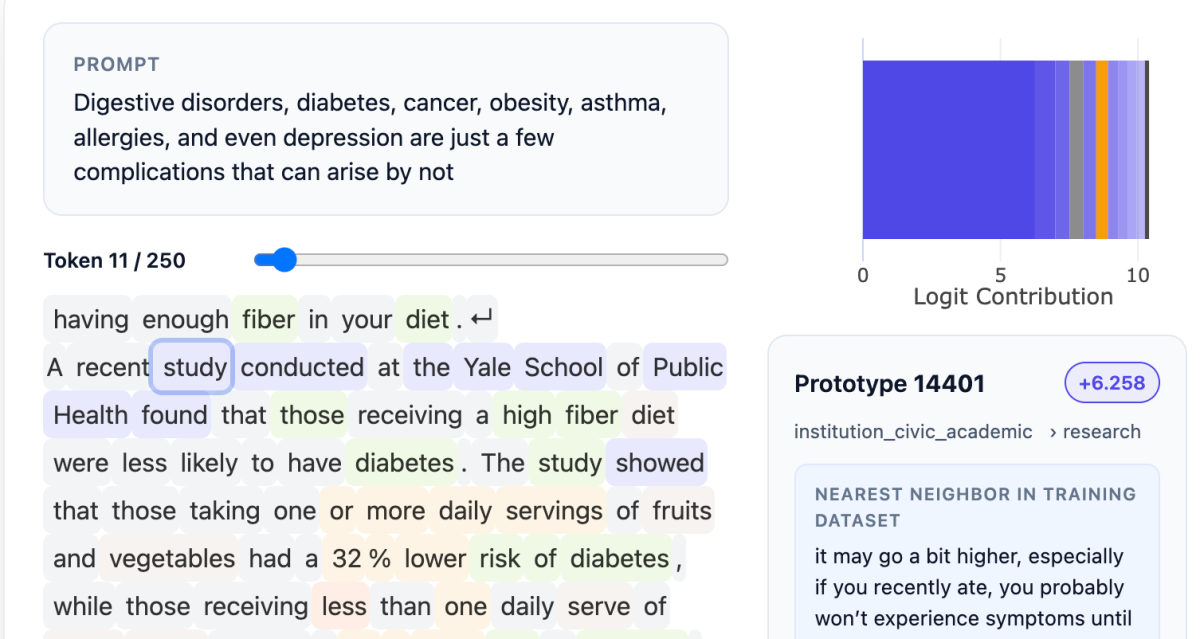

Steerling-8B的最大亮点在于其独特的训练架构。不同于标准Transformer模型,该模型引入了'模块化解释层'(Modular Interpretability Layers),每个处理模块都配备独立的可视化追踪器。用户可以通过API或Web界面实时观察token级别的注意力机制、逻辑推理路径,甚至是模型对输入的'因果归因'。

例如,在回答复杂问题时,Steerling-8B会生成一个'解释树',清晰展示从输入解析到输出生成的每一步决策依据。这类似于人类思维过程的'思维链'(Chain-of-Thought),但更结构化、可量化。Guide Labs声称,这种设计在基准测试中,解释准确率高达95%以上,远超现有开源模型如Llama 3。

训练过程也别具一格。模型使用合成数据集结合人类反馈强化学习(RLHF),并融入'对抗解释训练',迫使模型在生成输出时同时输出解释路径。参数规模虽为8B,但通过高效蒸馏技术,推理速度媲美更小模型,适用于边缘设备部署。

行业背景:可解释AI的迫切需求

回顾AI发展史,可解释性问题由来已久。2018年,DARPA推出XAI计划,推动从'可信AI'向实用化转型。近年来,随着欧盟AI法案的实施,高风险AI系统必须提供解释报告,否则面临巨额罚款。中国和美国也在跟进,强调'透明优先'。

现有解决方案如SHAP或LIME虽有效,但计算开销大,且多为后验分析,无法嵌入模型核心。Steerling-8B的先验设计填补这一空白。相比之下,Google的PaLM系列虽有部分解释工具,但不开源;Meta的Llama虽开源,却缺乏内置解释层。Guide Labs的举措无疑为开源社区注入新活力。

潜在影响与应用场景

Steerling-8B的开源(基于Apache 2.0许可)将加速生态建设。开发者可在其基础上微调,构建企业级聊天机器人、法律咨询系统或教育工具。例如,在医疗领域,医生能验证模型诊断的依据,避免误诊;在金融风控中,解释路径可满足监管合规。

性能基准显示,Steerling-8B在GLUE、SuperGLUE等任务上得分接近Llama 3 8B,同时解释模块仅增加5%的推理延迟。这使其成为'轻量级可解释AI'的典范。

编者按:迈向AI信任新时代

作为AI科技新闻编辑,我认为Steerling-8B不仅是技术突破,更是AI伦理的里程碑。当前,公众对AI的信任危机日益凸显——从Deepfake泛滥到算法歧视,透明度是解药。Guide Labs的创新提醒我们:强大不等于可靠,开源+可解释才是可持续路径。未来,我们期待更多企业效仿,推动AI从'工具'向'伙伴'演进。当然,挑战犹存,如解释的'真实性'验证和大规模部署的安全性,仍需社区共同攻克。

本文约1050字,编译自TechCrunch,原作者Tim Fernholz,发布于2026-02-24。

© 2026 Winzheng.com 赢政天下 | 转载请注明来源并附原文链接