SGLang团队盛装出席NVIDIA GTC 2026,带来专题讨论、Happy Hour、200人Meetup以及动手训练实验室。三天五场活动,置身LLM生态中心,收获满满。如果错过了,这里是完整回顾。

SGLang在GTC 2026:五场活动,三天盛会。

主会议亮点

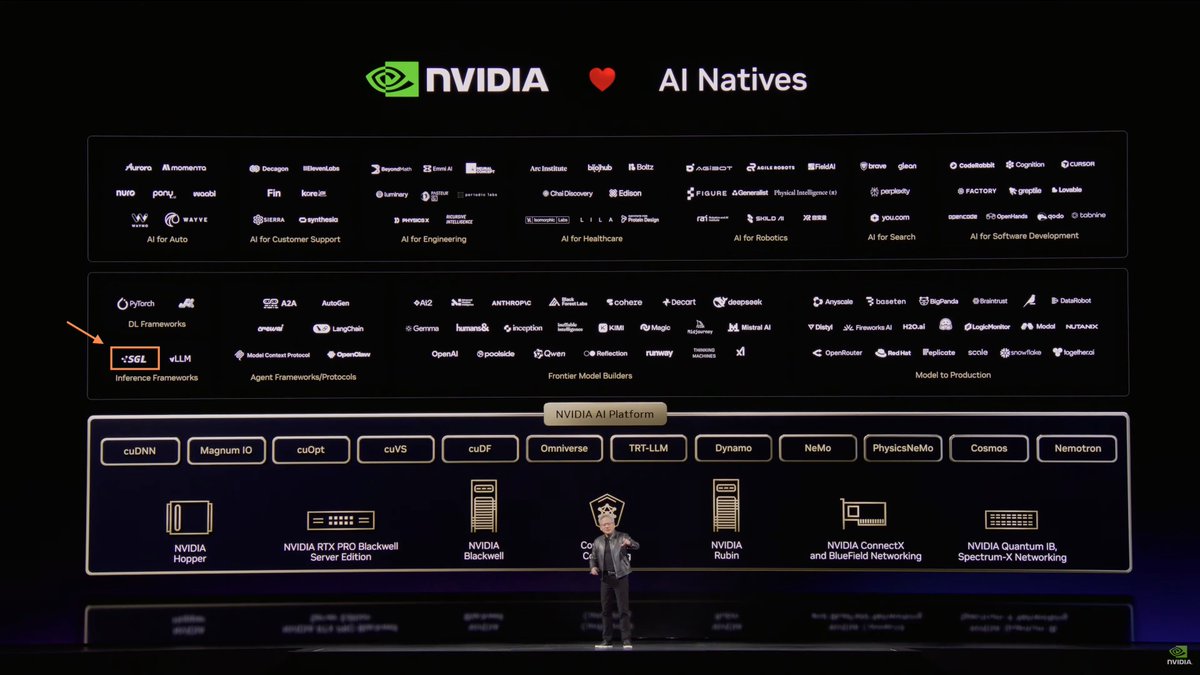

SGLang亮相GTC主旨演讲

SGLang在Jensen Huang的GTC主旨演讲中,被纳入NVIDIA AI生态幻灯片,荣幸入选支撑AI原生应用的底层基础设施栈。

SGLang现身NVIDIA GTC 2026主旨演讲AI生态幻灯片。

GTC开源AI专题讨论

周二,Ying Sheng参与GTC“开源AI现状”专题讨论,与NVIDIA战略AI负责人Vartika Singh、应用研究VP Jonathan Cohen、UC Berkeley教授Ion Stoica、Hugging Face产品VP Jeff Boudier及Ai2多模态AI总监Ranjay Krishna同台。

讨论聚焦开源AI作为复杂AI系统R&D核心引擎的角色:开源生态如何确保可信、可扩展、生产就绪,以及支持可复现、可审计研究的社区基础设施。

Ying Sheng(左二)参与GTC 2026“开源AI现状”专题讨论。

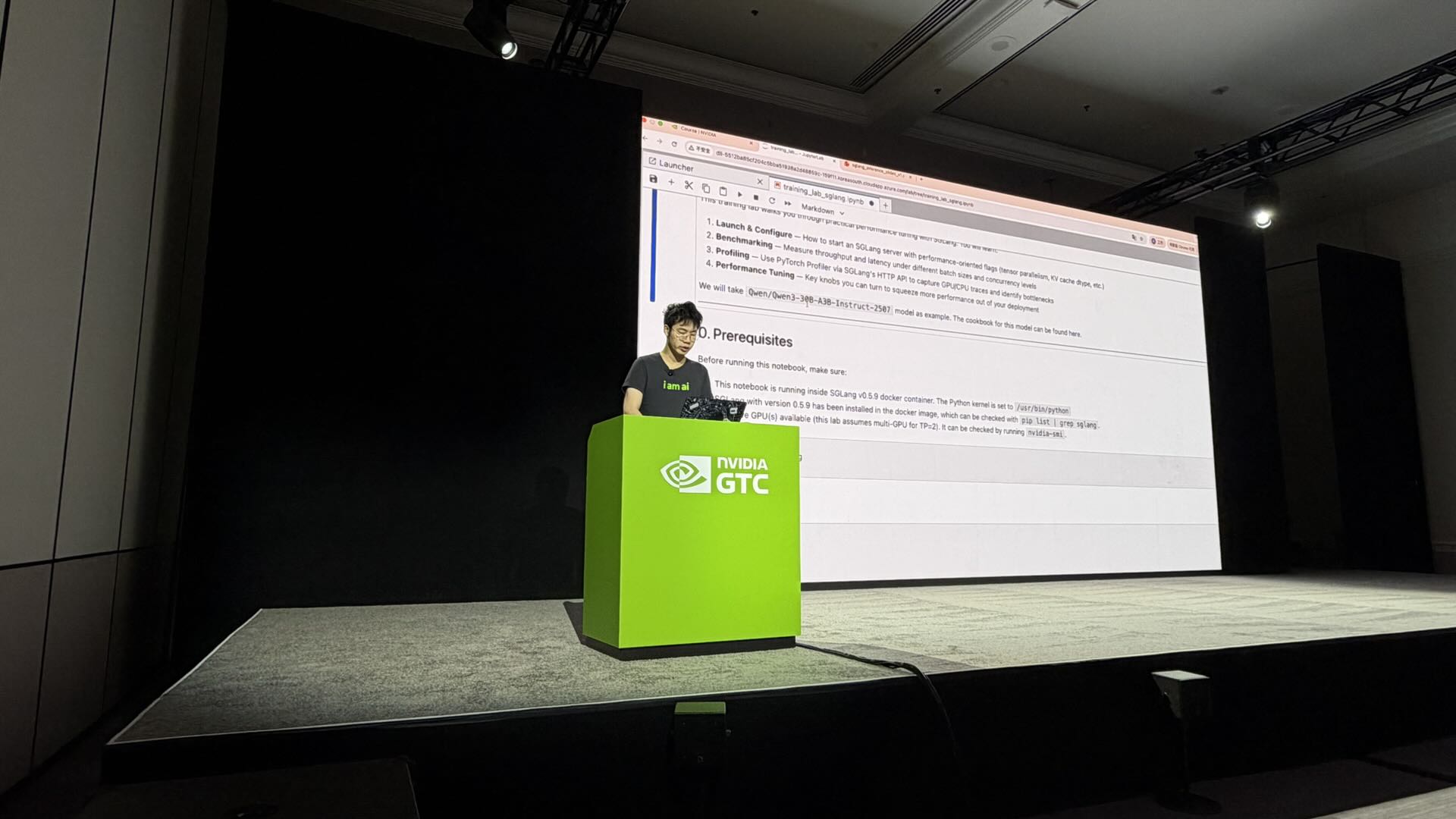

SGLang训练实验室

周四上午,RadixArk团队主讲官方GTC训练实验室:“使用SGLang实现高性能LLM服务与训练”。

实验室涵盖三方面:

- SGLang Cookbook性能调优:实际部署中提升服务吞吐量和延迟的实用技巧

- 性能剖析与瓶颈分析:开发者指南,识别并解决LLM服务系统瓶颈

- SGLang × Miles RL集成:实操演示,在Miles框架RL训练循环中使用SGLang作为推理后端

GTC 2026 SGLang训练实验室:动手LLM性能调优与RL训练。

🎬 NVIDIA On-Demand完整录像 | 📁 实验室资料下载

周边活动

SGLang × RadixArk GTC Happy Hour

周二晚,SGLang与RadixArk联合主办GTC Happy Hour,汇聚推理与训练生态的构建者、研究者和创始人,包括OpenAI、xAI、DeepMind、Meta、NVIDIA、Ollama等友人。

SGLang × RadixArk Happy Hour现场。

当晚两场技术焦点:

- Banghua Zhu (RadixArk):介绍RadixArk与Miles,SGLang原生RL训练框架,专为大规模MoE后训练设计。

- Jason Zhao (ScitiX):展示SiMM,开源内存KV缓存引擎,与SGLang集成支持长上下文服务。

Banghua介绍RadixArk与Miles RL框架。

感谢Z Potentials与ScitiX赞助。📝 X回顾帖

Banghua参与Novita GTC活动

Banghua Zhu出席700+人规模的Novita GTC活动。讨论Jensen Huang关于推理成本与需求拐点的观点、Agentic AI运动的关键驱动力,以及AI产品交付真实价值的要素。Banghua分享SGLang如何塑造推理基础设施未来,支持从OpenClaw到Agentic推理的下一代用例,推动开源模型与基础设施演进。

Banghua在Novita GTC活动演讲。

合作伙伴包括NVIDIA、RadixArk、OpenRouter、Google DeepMind、Kimi (Moonshot AI)、Alibaba Cloud、MiniMax、Z.ai、Hugging Face及Kilo Code。

LinkedIn × SGLang Meetup:LLM用于搜索与推荐

周三晚,我们在LinkedIn Mountain View总部举办约200名工程师Meetup,与LinkedIn、TikTok、Meta、NVIDIA团队深入探讨生产级LLM搜索与推荐系统。

LinkedIn Meetup SGLang周边。

LinkedIn工程分享

LinkedIn首场三场工程演讲:

- Fedor Borisyuk:大规模语义搜索

- Zhipeng Wang:LLM驱动排名建模优化

- Sundara Raman Ramachandran:LLM推理基础设施优化,包括仅预填充服务路径,在H100上实现2–3×吞吐量提升,已上游回SGLang

LinkedIn工程师分享语义搜索、排名与推理基础设施。

相关工作:[1] [2] 等 | LinkedIn博客

SGLang路线图与Miles框架

SGLang核心开发者Liangsheng Yin详解2026上半年路线图。

Mao Cheng介绍Miles RL框架,通过三项核心技术解决生产中训练-推理不匹配:

- 重要性采样校正:补偿训练与推理分布偏移

- 推理-训练对齐:确保 rollout行为与梯度更新一致

- Rollout Routing Replay (R3):基于重放的路由,提升生成rollout数据利用率

Mao Cheng讲解Miles RL框架与训练-推理对齐方法。

行业演讲

- Hongyu Lu (TikTok):大规模LLM搜索

- Luke Simon & Xi Liu (Meta):Generative Reasoning Reranker 论文

- Anish Maddipoti (NVIDIA):Dynamo + NeMoRL

专题讨论

Qing Lan主持闭幕讨论,嘉宾包括Wenfeng Zhuo、Fedor Borisyuk、Luke Simon与Mao Cheng。话题涵盖:

- 语义ID vs. 嵌入检索

- 统一检索+排名(OneRec式系统)是否生产就绪

- LLM推荐系统中的推理与训练挑战

- 加速LLM推荐采用的近期突破

- 生产推荐系统中持续学习的角色

闭幕讨论:Wenfeng Zhuo、Fedor Borisyuk、Luke Simon与Mao Cheng,由Qing Lan主持。

这正是定义下一代推荐系统的协作模式:生产团队与开源基础设施共同演进。📝 LinkedIn回顾帖

展望未来

GTC 2026凸显生产生态正围绕开源基础设施加速融合。从LinkedIn规模语义搜索,到前沿MoE模型RL后训练,SGLang日益成为底层共享层。我们将继续开源构建,关注Luma日历获取未来Meetup与办公时间。

© 2026 Winzheng.com 赢政天下 | 转载请注明来源并附原文链接